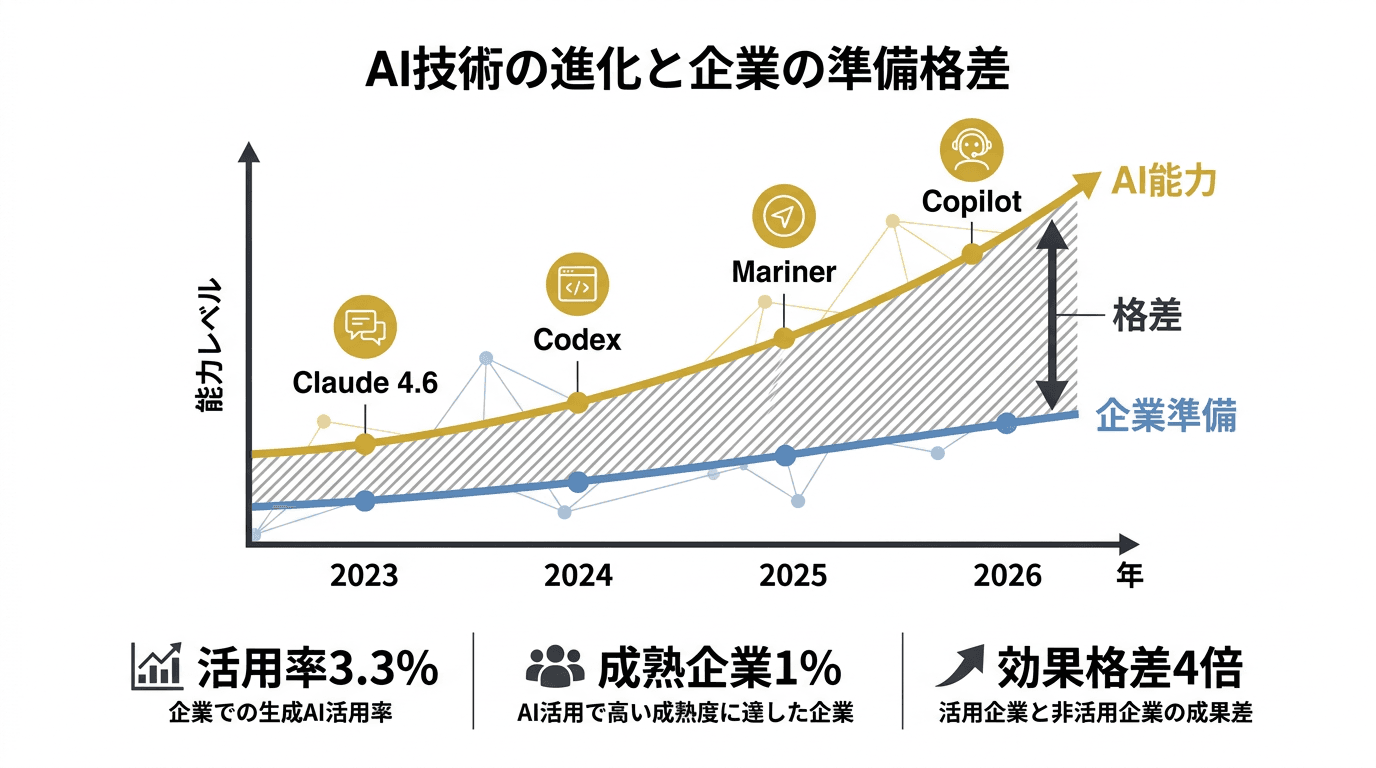

2026年3月現在、AIエージェントの能力は驚異的な速度で拡大しています。Anthropicの Claude Opus 4.6 は人間の専門家が約2年かかるタスクを自律的にこなし、OpenAIの Codex はコード生成からデプロイ・監視まで一貫して処理します。Google の Project Mariner は10タスクを同時に実行し、Microsoft Copilot はサイドバーの補助ツールから自律的なバックグラウンドエージェント群へと進化しました。

しかし、矢野経済研究所の調査では、日本企業でAIエージェントを「積極的に活用している」のはわずか3.3%。PwCの5カ国比較では、「期待以上の効果を得た」企業は米国51%に対し、日本は13%にとどまります。

この差はなぜ生まれるのか。結論から言えば、技術力の差ではありません。「どう任せるか」という委任スキルの差です。

本記事では、マネジメントの委任理論をAIエージェント活用に応用した「技術委任モデル」を提示し、5項目のレディネス評価で自社の現在地を診断する方法を解説します。

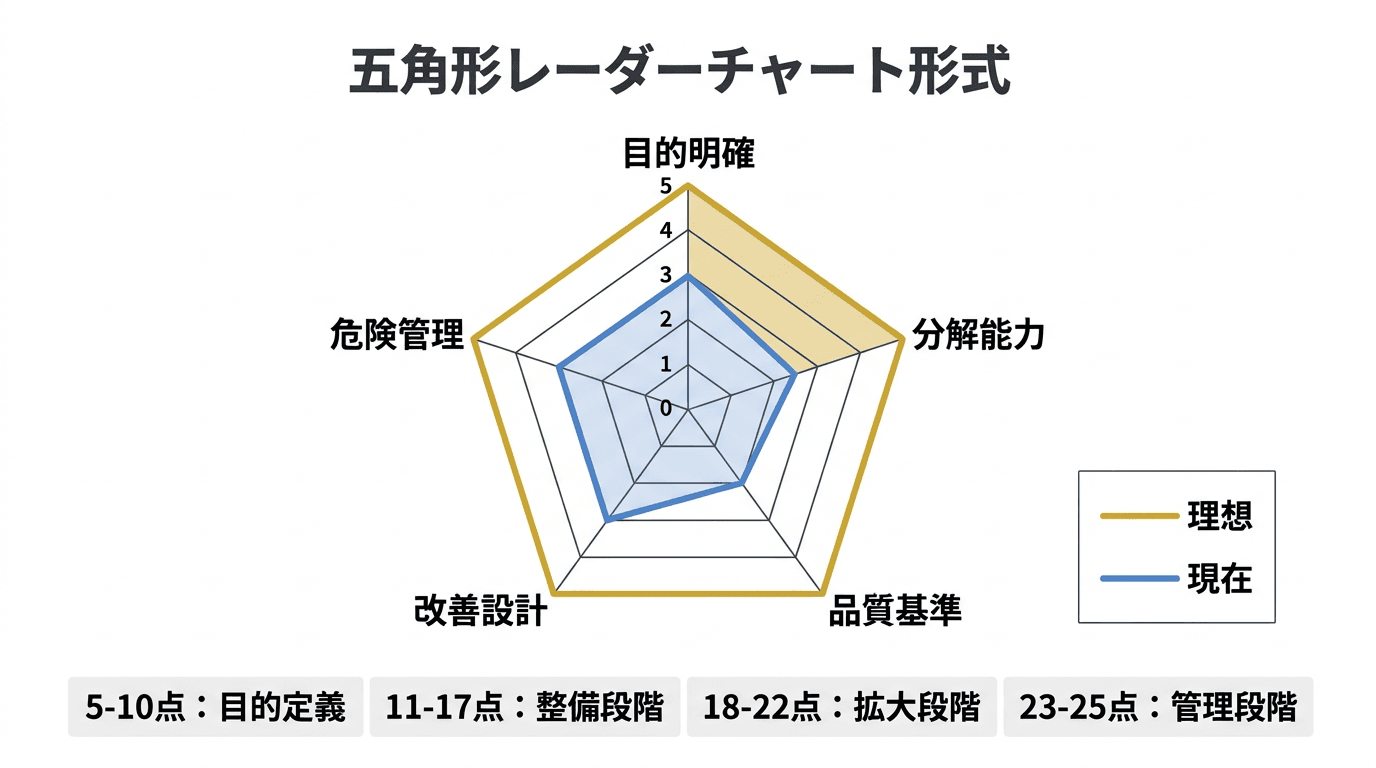

図1: 技術委任モデル — 人間からAIエージェントへの委任を5要素で設計する

なぜ「技術力」ではなく「委任力」が問題なのか

データが示す構造的なギャップ

Deloitteが24カ国3,235名のリーダーを対象にした「State of AI in Enterprise 2026」調査で、AIの最大障壁として挙げられたのは「ワーカーのスキル不足」でした。テクノロジーの問題ではなく、人の問題です。

BCGはこの構造を「10-20-70ルール」で説明します。AI導入の成功に必要なリソース配分は、テクノロジーが10%、プロセスが20%、そして人とチェンジマネジメントが70%です。ところが多くの企業は、テクノロジーに予算の大半を投下し、人材の変革に十分な投資をしていません。

McKinseyの調査はさらに厳しい現実を示しています。AI投資を増やす予定の企業は92%に達する一方、AI成熟度に達した企業はわずか1%。投資と成果の間に巨大な断絶があるのです。

総務省データに見る日本の課題

総務省「情報通信白書2025」によると、日本の企業における生成AI利用率は55.2%。一見すると高いように見えますが、中国95.8%、米国90.6%と比較すると大きく後れを取っています。さらに問題なのは、AI活用方針を策定している企業が日本では約50%にとどまるのに対し、他国では約90%に達している点です。

最も多く挙がる課題は「効果的な使い方がわからない」。ツールは手に入れたが、使いこなせていないという状況です。

問題は「AIを導入するかどうか」ではなく「AIにどう仕事を任せるか」。この記事では、マネジメントの委任理論をAIに応用することで、この「任せ方」を体系化します。

「技術委任モデル」— マネジメントの知見をAIに適用する

委任理論とは何か

マネジメントの世界では、「委任(delegation)」は古くから研究されてきたテーマです。ハーバードビジネススクールの研究では、委任が上手なリーダーは生産性が最大33%高いことが示されています。

2026年2月、Google DeepMindの研究チームは「Intelligent AI Delegation」と題した論文を発表し、マネジメントの委任理論をAIシステムに明示的に適用するフレームワークを提唱しました。権限・責任・アカウンタビリティの移転、役割と境界の明確化、意図の明確性(軍事的な「指揮官の意図」に相当)を、AI委任の基盤と位置づけています。

同時期にHBRは「Agent Managers」という新しい役割を提唱し、AIエージェントの学習・協調・パフォーマンスを管理する専門人材の必要性を論じました。注目すべきは、ドメイン専門性がAI技術の専門性より重要と指摘している点です。

これらの最新研究を統合し、日本のビジネスパーソン向けに再構成したのが「技術委任モデル」です。

技術委任モデルの5要素

技術委任モデルは、マネジメントの委任理論から導出した5つの要素で構成されます。

1. 目的明確性 — 「何を達成したいか」を言語化するMIT Sloanの研究では、委任の効果を左右する2軸として「人への信頼」と「プロセスへの信頼」が挙げられています。AIにおいて「人への信頼」はモデルの能力への信頼、「プロセスへの信頼」はワークフローの設計品質に相当します。どちらの信頼を構築するにも、まずゴールが明確でなければ始まりません。

「売上を上げる提案書を書いて」ではなく、「年商50億円のSaaS企業のCTOに対し、当社のAPI連携機能が開発工数を30%削減できることを3ページで伝える提案書」。この具体性の差が、AI活用の成果を決定的に分けます。

2. タスク分解 — 検証可能な単位に分ける具体例 — SaaS営業チームでの目的定義: ある従業員50名規模のSaaS企業の営業チームでは、当初「AIで提案書を作って」という曖昧な指示でAIを使い始めました。出力は毎回フォーマットが異なり、顧客の課題との接点が薄い汎用的な内容ばかり。そこで目的を「商談前に取得したBANT情報(予算・決裁者・ニーズ・導入時期)を基に、顧客の業界KPIと自社機能の対応表を含む提案書ドラフトを生成する」と再定義しました。この変更だけで、営業担当者のレビュー・修正時間が平均2.5時間から40分に短縮し、提案書の顧客採用率も改善しました。AIの能力が変わったのではなく、委任の「目的」が変わったのです。営業部門でのAI活用パターンをさらに深掘りしたい場合は「営業AI完全ガイド2026」も参照してください。

Wharton大学のEthan Mollick教授は、AI活用のユーザー類型を「Centaurs(ケンタウロス型)」と「Cyborgs(サイボーグ型)」に分類しています。Centaursは人間とAIで作業を明確に分担し、CyborgsはAIと一体化して作業します。いずれの場合も、タスクを適切な粒度に分解する能力が前提となります。

ハーバードビジネススクールとP&Gの共同実験(2025年、791名対象)では、AIを使った個人がAIなしのチーム全体と同等の成果を出し、かつ16.4%の時間短縮を達成しました。この成功の鍵は、AIに渡すタスクの粒度を「2時間以内に完了でき、入力と出力が明確な単位」に分解していた点にあります。

3. 品質基準 — 合格ラインを先に決める「いい感じに仕上げて」は、人間の部下への委任でも失敗しやすい指示です。AIへの委任では致命的です。

品質基準は委任の前に定義します。「顧客名・課題・提案の3要素が含まれていること」「根拠となるデータが2つ以上引用されていること」「です/ます調で統一されていること」のように、合否を判定できる基準を設定してからAIに依頼します。

4. フィードバック設計 — 結果を評価し改善する具体例 — 製造業の品質管理レポート: ある中堅製造業(従業員300名)では、毎週の品質管理レポート作成に工場長が3時間を費やしていました。AIに「品質レポートを書いて」と委任したところ、数値の羅列だけで原因分析のない報告書が生成されました。そこで品質基準を事前に定義しました。「不良率が前週比0.5%以上増加した項目には原因仮説を3つ以上記載すること」「各仮説に対して推奨アクションを1つ以上提示すること」「データの出典を製造ラインごとに明記すること」。この3つの合格基準を設定してからAIに委任した結果、レポート作成時間は3時間から30分に短縮し、さらに人間が見落としていた工程間の相関パターンをAIが指摘するケースも生まれました。品質基準を「先に決める」ことで、AIの出力は「確認して使える成果物」に変わります。

MISQ(2025年9月)に掲載された875名の店舗マネージャーを対象とした縦断研究では、「分極化効果」が確認されています。AIの能力を認識したマネージャーは時間とともに委任量を増やし、懐疑的なマネージャーは逆に減らしていく。そして高委任グループのほうが成果を上げました。

この差を生むのがフィードバックループです。AIの出力を評価し、次の指示に反映するサイクルを設計することで、委任の質は継続的に向上します。

5. リスク管理 — 失敗時の影響を見積もるGartnerは、2027年末までにエージェントAIプロジェクトの40%以上がキャンセルされると予測しています。主な原因はコスト肥大、不明確なROI、そしてリスク統制の不備です。

すべてのタスクに同じレベルの自律性を与えるのは危険です。社内向けの議事録要約と、顧客への契約書ドラフトでは、失敗時の影響がまったく異なります。タスクごとにリスクを評価し、自律度を調整する設計が必要です。

このリスク評価を体系化するために、技術委任モデルの応用として「委任リスク・マトリクス」を提案します。縦軸に「失敗時の影響度」(社内限定/顧客接点/法的リスク)、横軸に「タスクの発生頻度」(日次/週次/月次)を取り、4象限でAIへの委任レベルを決定する手法です。

| 高頻度(日次〜週次) | 低頻度(月次〜四半期) | |

|---|---|---|

| 影響度:低(社内限定) | Level 4-5で委任。議事録要約、社内FAQ回答、日報集計など。自動実行+定期サンプルチェック | Level 3で委任。社内研修資料の初稿、部門報告書など。AIが作成し人間が承認 |

| 影響度:高(顧客接点・法的リスク) | Level 2-3で委任。顧客メール返信ドラフト、見積書作成など。AIがドラフトし必ず人間が確認 | Level 1-2で委任。契約書レビュー、コンプライアンス報告など。AIは調査・下書きのみ、判断は人間 |

具体例 — 法務部門での委任リスク・マトリクス適用: ある上場企業の法務部門(5名体制)では、月間約80件の契約書レビューを処理していました。AIエージェントに全件を同じLevel 3(ドラフト作成→人間承認)で委任したところ、NDA(秘密保持契約)のような定型契約で過剰な確認工数が発生する一方、M&A関連の複雑な契約書でAIの見落としが2件発生しました。委任リスク・マトリクスを適用し、NDAや業務委託基本契約など定型的な契約(月60件)はLevel 4(AIが判定し異常値のみ報告)、M&Aや知的財産関連の契約(月20件)はLevel 2(AIが論点を整理し弁護士が全件レビュー)に分けました。この結果、法務部門の月間レビュー工数は40%削減され、かつ重要契約の見落としはゼロになりました。

委任の5レベル — AIにどこまで任せるか

経営コンサルタントのMichael Hyattは、委任を5つのレベルで体系化しました。この枠組みは、AIエージェントへの委任度を設計する際にそのまま適用できます。

| レベル | 人間の委任 | AIエージェントでの実践例 | 必要な信頼度 |

|---|---|---|---|

| L1: 指示実行 | 「この手順通りにやって」 | テンプレートに沿った定型文作成、データ入力 | 低(検証容易) |

| L2: 調査報告 | 「調べて報告して」 | 競合情報の収集・要約、市場データの整理 | 低〜中 |

| L3: 提案承認 | 「案を出して、私が決める」 | 提案書の初稿作成、戦略オプションの比較 | 中(判断は人間) |

| L4: 実行報告 | 「やって、結果を教えて」 | メール返信のドラフト→送信、定例レポート作成→配信 | 高(プロセス確立済み) |

| L5: 完全委任 | 「判断も含めて任せる」 | バグ修正→テスト→マージの一貫実行、定型問い合わせへの自動回答 | 最高(実績と品質保証) |

委任レベルの決め方

最初はすべてのタスクをLevel 1-2で始め、実績を蓄積してから段階的にレベルを上げるのが安全です。いきなりLevel 5を目指すと、Gartnerが警告する「プロジェクトキャンセル」の典型パターンに陥ります。

2026年の主要AIエージェントは、すでにLevel 4-5の能力を持っています。Claude Opus 4.6のMETRタイムホライズンは719日、つまり人間の専門家が約2年かけるタスクを自律実行できるポテンシャルがあります。OpenAI CodexはPRDの作成からコード実装、テスト、デプロイまでを一貫して処理します。

しかし、能力があることと、任せて良いことは別です。Google DeepMindの論文が強調するように、「委任レベル」は機械の能力ではなく、人間側の準備状態(目的の明確さ、品質基準の整備度、リスク許容度)で決まります。

段階的信頼構築サイクル — Level 1からLevel 5への実践ロードマップ

委任レベルの理論を理解しても、「具体的にどうやってレベルを上げるのか」が見えなければ実行に移せません。ここでは、技術委任モデルの応用として「段階的信頼構築サイクル」を提案します。1つのタスクについてLevel 1から始め、4つのステップを繰り返すことでLevel 5まで引き上げる実践的なプロセスです。

ステップ1:小さく試す(1〜2週間)。 対象タスクをLevel 1(指示実行)でAIに委任し、出力を全件確認する。この段階の目的は成果を出すことではなく、AIの得意・不得意パターンを把握することです。

ステップ2:基準を固める(2〜4週間)。 ステップ1で得た知見を基に、品質基準とフィードバックテンプレートを文書化する。「AIがよく間違えるポイント」「人間が修正する頻度が高い箇所」をリスト化し、次の委任指示に反映する。

ステップ3:自律度を上げる(1〜2ヶ月)。 品質基準をクリアする出力が安定してきたら、Level 2→3→4と段階的に自律度を引き上げる。各レベルで最低2週間の安定稼働を確認してから次に進む。

ステップ4:例外処理を設計する(継続)。 Level 4以上で運用する場合、AIが判断に迷うケースや品質基準を満たさないケースの「エスカレーション・ルール」を定義する。人間に戻す条件を明確にすることで、完全委任でも品質を担保できる。

具体例 — カスタマーサクセス部門での段階的信頼構築: あるBtoB SaaS企業のカスタマーサクセスチーム(8名)では、解約兆候の早期発見が課題でした。まずLevel 1として、AIに「過去3ヶ月のログイン頻度・機能利用率・サポート問い合わせ数を集計し、前月比で表にまとめる」という定型タスクを委任。2週間の全件確認で、AIが集計ミスをしやすいデータパターン(複数契約を持つ顧客の名寄せ)を特定しました。次にLevel 2へ移行し、「集計結果から解約リスクが高い顧客を上位10社リストアップし、各社のリスク要因を3点以内で報告する」に拡張。さらに2ヶ月後、Level 3として「リスク上位10社に対する個別フォロー施策の提案」まで任せるようにしました。現在はLevel 4で運用中で、AIが毎週月曜に解約リスクレポートと対応施策案を自動生成し、CSマネージャーは承認と優先度調整に集中しています。段階的に信頼を構築した結果、チームの解約予防対応のカバー率は月20社から月50社に拡大し、解約率は前年比で1.8ポイント改善しました。

この段階的信頼構築サイクルは、AI導入90日計画のフェーズ設計とも整合します。最初の30日でLevel 1-2を試行し、60日目までにLevel 3への移行判断を行い、90日目にはLevel 4の安定運用を目指すスケジュールが現実的です。

5項目レディネス評価 — 自社の現在地を診断する

以下の5項目で、自社のAIエージェント活用レディネスを評価します。各項目を1〜5点で自己採点し、合計点から現在の委任レベルと次のアクションを判断してください。

| 評価項目 | 1点(未整備) | 3点(部分的) | 5点(確立済み) |

|---|---|---|---|

| 目的明確性: AIに委任する業務の目的が言語化されているか | 「AIを使ってみたい」レベル。具体的なゴールが未定義 | 一部の業務で目的が明確だが、全体像は曖昧 | 業務ごとに達成基準・KPIが定義済み |

| タスク分解: 業務を検証可能な単位に分解できているか | 大きな塊のまま「これやって」と丸投げ | 主要工程は分解済みだが、判断基準が属人的 | 2時間以内・入出力明確な単位に分解済み |

| 品質基準: AIの出力を評価する合格基準があるか | 「いい感じかどうか」で判断 | チェックリストはあるが運用が不統一 | 項目別の合否基準が文書化され、誰でも判定可能 |

| フィードバック: 評価結果を次の改善に反映する仕組みがあるか | やりっぱなし。同じ指示を繰り返す | 気づいたら修正するが、体系的ではない | 評価→分析→改善の定期サイクルが回っている |

| リスク管理: タスクごとに自律度を使い分けているか | すべてのタスクに同じ使い方 | 重要度に応じて確認頻度を変えている | リスク分類表があり、タスクごとに委任レベルを設定 |

図4: 5項目レディネス評価 — 理想と現在地のギャップから次のアクションを導く

合計スコア別の診断と次のアクション

5〜10点:Level 1「まず目的を定義する」段階AIを使い始める前に、「どの業務の、何を、どこまで」任せたいのかを書き出すところから始めてください。PwCの調査でCAIO(Chief AI Officer)を設置している企業は高効果群の60%を占めていますが、役職は必須ではありません。推進責任者を1名決め、対象業務を3つに絞ることが第一歩です。この段階で陥りやすい典型的な失敗パターンについては「AI導入で失敗する7つの課題」が参考になります。

11〜17点:Level 2-3「プロセスを整備する」段階目的は見えているが、品質基準やフィードバックの仕組みが追いついていない状態です。Deloitteの調査で「Surface-level use」と分類される37%の企業に近いポジションと考えられます。ここでの最優先アクションは、品質基準の文書化です。「AIの出力がOKかどうかを、担当者以外でも判断できる基準」を3つの業務で作成してください。組織全体への定着を進めるためのチェンジマネジメント手法は「AIエージェント組織定着のチェンジマネジメント」で詳しく解説しています。

18〜22点:Level 4「委任範囲を拡大する」段階基盤が整っている企業です。次のステップは、Level 3(提案承認)で運用しているタスクのうち、実績が安定しているものをLevel 4(実行報告)に引き上げることです。Ethan Mollick教授の「Centaurs型」から「Cyborgs型」への移行、つまり人間とAIの作業境界をさらに曖昧にし、統合度を高めるフェーズです。

23〜25点:Level 5「エージェントマネジメント」段階HBRが提唱する「Agent Managers」の配置を検討する段階です。複数のAIエージェントを協調させ、エージェント間の品質管理、人間へのエスカレーション設計、ROI測定を体系的に行います。Gartnerが予測する「エージェントAIプロジェクトの40%キャンセル」を回避するために、リスク統制の強化が不可欠です。

2026年の現実 — 能力の爆発と信頼のギャップ

図5: 2026年の構造的課題 — AI能力の急拡大と企業の準備度ギャップ

METRの調査データによると、AIエージェントのタスク完了能力は2019年から2025年にかけて約7ヶ月ごとに倍増し、2024年以降は約4ヶ月ごとに加速しています。Claude Opus 4.6が719日のタイムホライズンを達成し、Claude Codeは6ヶ月でARR 10億ドルに到達しました。

一方で、McKinseyの調査ではAI成熟企業はわずか1%、Gartnerは「エージェント洗い(agent washing)」として実態のないAIベンダーが数千社に上ると警告しています。本物のエージェントAIベンダーはわずか約130社という見積もりです。

能力は十分にある。しかし、任せるための準備が追いついていない。 これが2026年の構造的な課題です。

P&Gとハーバードビジネススクールの共同実験は、この課題の解決策を示唆しています。791名を対象としたこの実験では、適切にAIを活用した個人が、AIなしのチーム全体と同等の成果を達成しました。しかもAI活用者のほうが高い意欲とエネルギーを報告し、機能間のサイロも解消されました。

鍵は「優れたAIツールを使ったこと」ではなく、「タスクの切り分け方と品質評価の基準が明確だったこと」です。これはまさに、技術委任モデルの5要素そのものです。

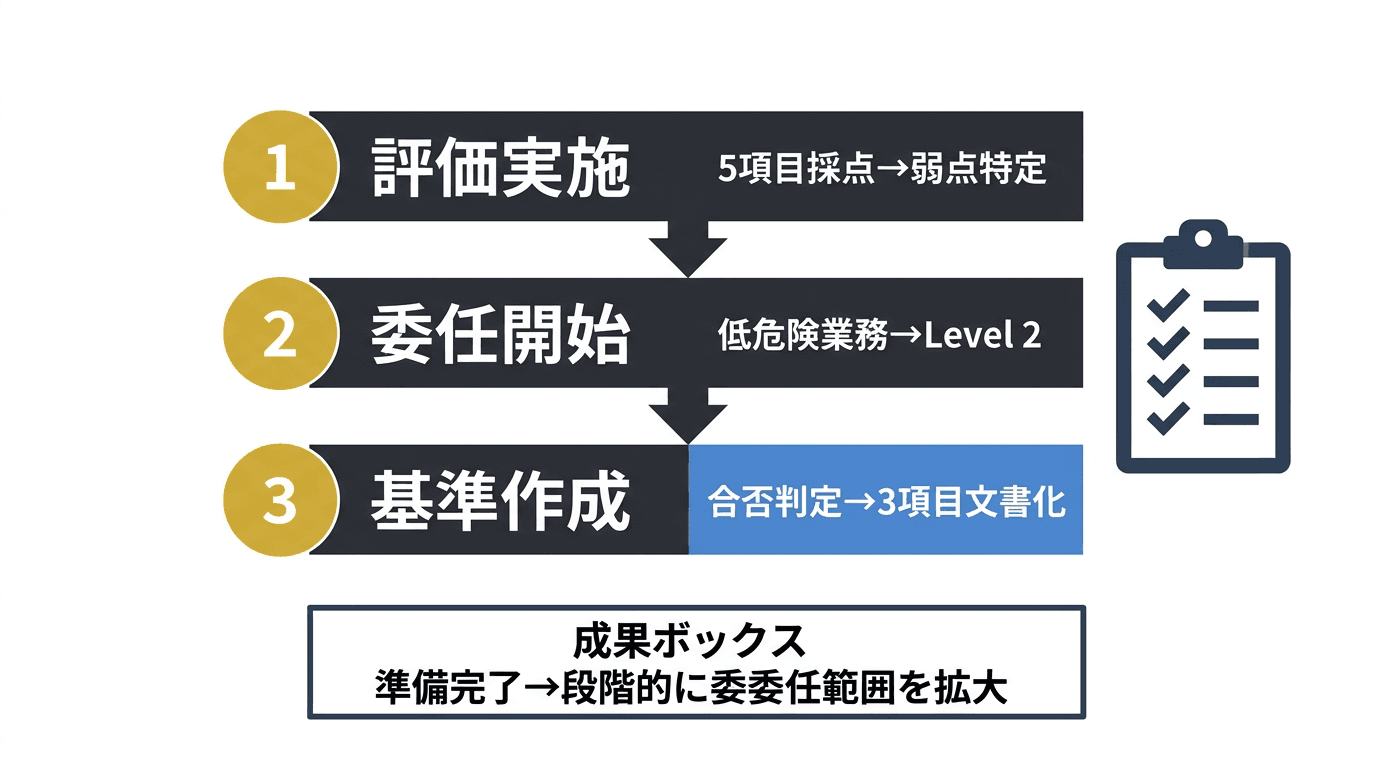

図6: 今日からできる3つのアクション — レディネス評価・委任実践・品質基準

まとめ — 今日からできる3つのアクション

AIエージェントの能力は、もはや多くの実務タスクで人間に並び、一部では上回っています。しかし、その能力を引き出せるかどうかは、技術力ではなく委任力にかかっています。

今日からできる3つのアクション:- レディネス評価を実施する — 上記の5項目で自社の現在地を採点し、最もスコアが低い項目を特定する

- 1つの業務でLevel 2を試す — 競合情報の収集や会議議事録の要約など、リスクが低い業務でAIへの委任を始める

- 品質基準を1つ書く — 「AIの出力がOKかどうか」を判断する基準を、最初の対象業務について3項目で文書化する

AIを「魔法の道具」としてではなく、「仕事を任せる相手」として捉え直すこと。その視点の転換が、日本企業のAI活用を次の段階に引き上げる最も確実な方法です。各業務部門での具体的なAIエージェント導入パターンについては「AIエージェント活用事例20選」も参考にしてください。

Agenticベースでは、AIエージェントの導入設計から運用体制の構築、レディネス評価の実施支援まで対応しています。 お問い合わせはこちら →

この記事の著者

Agentic Base 編集部

AIエージェントとWebメディア運用の知見を活かし、実践的なナレッジを発信しています。