「AIで記事を書いてもらっていたら、他社サイトと酷似した文章が納品された」。 実際の相談事例をもとに構成した、典型的なトラブルシナリオです。コンテンツ制作をB社に業務委託していたところ、B社がAIを活用して記事を生成していることが途中で判明しました。問題が発覚し、A社は契約書を確認しましたが、AI利用に関する条項は一切記載されていませんでした。生成物の権利帰属も、AIに投入したデータの取扱いも、品質保証の範囲も、すべてが契約上の空白地帯だったのです。

「まさか委託先がAIを使うとは想定していなかった」という弁明は、2026年の業務委託ではもう通用しません。本稿では、AI活用業務の委託契約に必要な条項を5つのカテゴリで整理し、独自の「AI条項成熟度モデル」を使って自社の契約を段階的に強化する方法をご紹介します。すべての契約を一度に完璧にする必要はありません。案件の規模とリスクに応じて、着実にレベルを上げていくアプローチです。

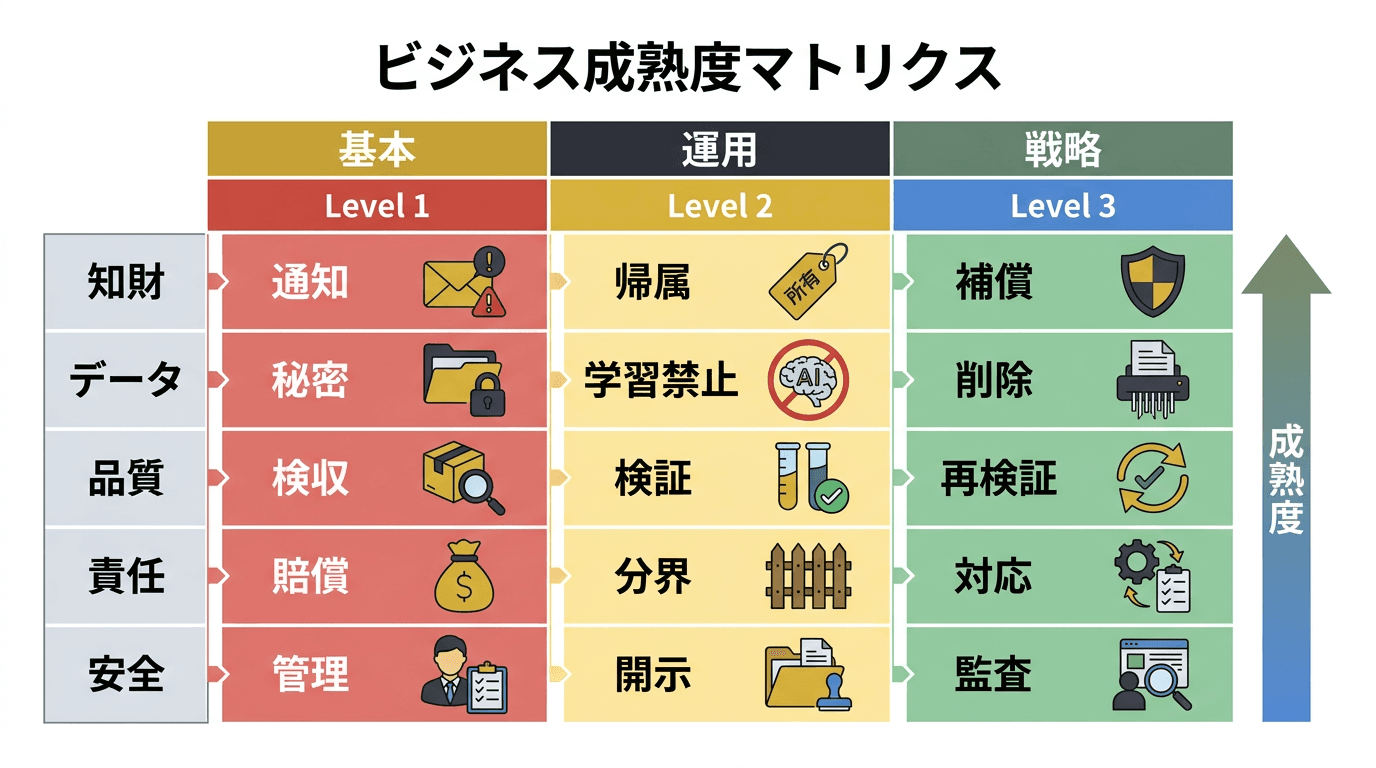

図1: AI条項成熟度モデル — 5つの条項カテゴリを3段階で段階的に強化する

なぜ「AI条項を追加するだけ」では足りないのか

従来の契約書が想定していないリスク

業務委託契約には通常、成果物の権利帰属、秘密保持、品質保証、損害賠償の条項が含まれています。しかしAI活用業務には、従来の契約条項では対応しきれない固有のリスクが4つあります。

- 生成物の権利が不確定: AIが生成したコンテンツの著作権は、日本の現行法では「思想又は感情を創作的に表現したもの」に該当するかで判断が分かれます。AIの出力がそのまま成果物になる場合、著作権が発生しない可能性があり、権利帰属条項の前提そのものが揺らぎます

- 学習データへの流入リスク: 委託先がAIツールに投入したデータが、モデルの学習に利用される可能性があります。自社の営業データや顧客情報が、意図せず他社の利益に活用されるリスクです

- 品質の予測困難性: AIの出力には誤情報の生成(ハルシネーション)が含まれることがあります。従来の品質保証条項は「人が作成したもの」を前提としており、AI出力の検証プロセスまでカバーしていません

- モデル更新による品質変動: AIモデルはバージョンアップで出力の傾向が変わります。契約締結時に確認した品質水準が、半年後には再現できなくなるリスクがあります

行政も「AI契約は別枠」と位置づけている

経済産業省は2025年2月に「AIの利用・開発に関する契約チェックリスト」を公表し、AI契約を従来の委託契約とは別の確認項目で点検すべきことを示しました。また、2025年3月公表の「AI事業者ガイドライン(第1.1版)」は、事業者側の説明責任やガバナンス体制を定めた文書であり、契約条項そのものを規定するものではありませんが、委託先に求めるべき統制水準を検討する際の参考になります。

つまり、既存の契約書にAI関連の一文を追加するだけでは不十分です。AI固有のリスクに対応した条項体系を、別のレイヤーとして設計する必要があります。

経済産業省の「AI・データの利用に関する契約ガイドライン」ポータルでは、データ利用・知的財産・責任分界の条項例が体系的に整理されています。AI契約の条項設計を始める際の起点として活用できます。

AI条項成熟度モデル:3段階で現在地を把握する

すべての委託契約に最初から完璧なAI条項を盛り込む必要はありません。案件の規模やリスクの大きさに応じて段階的に強化する設計が実務的です。ここでは、AI条項の整備状態を3段階で評価する「AI条項成熟度モデル」をご紹介します。

Level 1: 基本法令遵守。 AIの利用有無を契約で明示し、最低限の法令遵守条項を確保している段階です。「委託業務にAIを使用する場合は事前に通知すること」「個人情報保護法に従って取り扱うこと」といった基本事項が記載されています。多くの既存契約はこの段階にあるか、Level 1にすら到達していない状態です。冒頭のA社のケースはまさに、Level 1未満の契約でトラブルが起きた典型例です。

Level 2: 運用の明確化。 AI利用の条件、出力の検証プロセス、データの取扱いルールが具体的に規定されている段階です。「AIの出力は必ず人がレビューしてから納品すること」「投入データはモデル学習に使用しない設定で利用すること」「利用するAIツールを事前に開示すること」といった運用ルールが契約に明記されています。委託業務の中身が見える状態になり、トラブル発生時の原因切り分けが格段に容易になります。

Level 3: 戦略的保護。 知的財産の帰属、監査権、インシデント対応、契約終了時のデータ処理まで網羅的に規定されている段階です。「生成物に第三者の権利侵害が発見された場合の補償手順」「発注者による利用状況の監査権」「契約終了時に投入データをすべて削除し、削除証明書を発行する手順」など、リスクの発生から契約終了後の処理までをカバーしています。

| 段階 | 定義 | 到達要件 | 次のステップ |

|---|---|---|---|

| Level 1 基本法令遵守 | AI利用の明示と法令遵守の確認 | AI利用有無の記載、個人情報保護条項、秘密保持条項 | 運用ルールの具体化へ |

| Level 2 運用明確化 | AI利用条件と品質管理の具体化 | 出力検証プロセス、データ取扱いルール、ツール開示 | 知財・監査・終了処理の追加へ |

| Level 3 戦略的保護 | リスク発生から終了後まで網羅 | 権利帰属、監査権、インシデント対応、終了時処理 | 法改正・標準更新に応じた定期見直しへ |

段階を決める3つの条件

すべての契約をLevel 3にする必要はありません。以下の3条件の掛け合わせで、目指すべきレベルを判断します。

- 案件規模: 年間の委託金額が大きいほど、契約紛争時のインパクトが大きくなります。小規模な単発案件ならLevel 1で十分ですが、年間契約額が数百万円を超える継続案件ではLevel 2以上を目指してください

- データの機微性: 個人情報や営業秘密など、機微性の高いデータをAIに投入する案件では、規模に関わらずLevel 2以上が必要です。医療データや金融データを扱う場合はLevel 3が前提となります

- 規制影響: EU AI Act(EUのAI規制法)の高リスクAI分類に該当する業務や、個人情報保護法の委託規制が適用される場合は、Level 2以上で規制対応条項を組み込む必要があります

小規模案件でも、個人データや高リスク用途を扱う場合はLevel 1では不十分です。「案件が小さいから簡易な契約で良い」という判断は、データ機微性を確認してから行ってください。

5つの条項カテゴリとチェックポイント

AI条項を整理する際は、以下の5つのカテゴリに分けて漏れがないか確認します。各カテゴリの主要チェックポイントを成熟度レベル別に整理しました。

| カテゴリ | Level 1の必須事項 | Level 2の追加事項 | Level 3の追加事項 |

|---|---|---|---|

| 知的財産 | AI利用の事前通知 | 生成物の権利帰属の明記 | 第三者権利侵害時の補償手順 |

| データ利用 | 秘密保持条項 | モデル学習への不使用条件 | 契約終了時のデータ削除・証明 |

| 品質保証 | 成果物の検収基準 | AI出力の人的レビュー義務 | モデル変更時の品質再検証 |

| 責任分界 | 損害賠償の上限設定 | AI起因事故の責任配分 | インシデント対応フローの文書化 |

| セキュリティ | 情報管理の基本規定 | 利用ツール・API接続先の開示 | 発注者による監査権の付与 |

各カテゴリの実務上のポイントを補足します。

知的財産では、「AIが生成した成果物の権利は誰に帰属するか」を明確に定めることが最重要です。現行の著作権法ではAI生成物に著作権が発生しない可能性があるため、「著作権の有無に関わらず、成果物の利用権は発注者に独占的に帰属する」といった包括的な文言が実務的です。また、受託者が生成物を自社のポートフォリオや他案件の参考として利用できるかどうかも、明示的に定めておく必要があります。

データ利用では、個人情報保護委員会(PPC:個人情報の保護に関する行政機関)のガイドライン(通則編)が、委託時の安全管理措置と監督責任を明確に定めています。委託先がAIツールにデータを入力する場合、「クラウドサービスの利用が個人情報保護法上の委託に該当するか否か」(PPC FAQ Q7-54参照)の整理も事前に行ってください。モデル学習への不使用を契約で定めたとしても、AIサービス提供者の利用規約で学習利用が許容されているケースがあるため、サービス側の規約との整合確認が欠かせません。

品質保証では、「AIの出力を人がレビューしてから納品する」プロセスの規定が鍵になります。レビューの対象範囲(事実確認、著作権侵害チェック、ブランドトーンの確認など)と、レビュー結果の記録・保管義務まで定めておくと、トラブル発生時の検証が可能になります。AIモデルのバージョン更新で品質が変動した場合に備え、「使用モデルのバージョンを固定する」「変更時は事前通知する」といった条項も有効です。

責任分界では、AI起因の事故(誤情報の生成、第三者の権利侵害、データ漏洩)が発生した場合に、発注者と受託者のどちらが対応責任を負うかを事前に合意しておきます。AI起因か人為的ミスかの切り分けが難しい場合の暫定対応ルール——たとえば「原因調査中は受託者が初動対応を行い、原因確定後に費用負担を協議する」——まで定めておくと、紛争時の初動が速くなります。

セキュリティでは、NIST AI RMF(米国国立標準技術研究所のAIリスク管理フレームワーク)のGenerative AI Profileが、契約条項とセキュリティ統制を接続する設計として有用です。また、CISA(米国サイバーセキュリティ・インフラセキュリティ庁)は2025年5月に「AI Data Security Best Practices for Generative AI」を公表し、生成AI利用時のデータセキュリティに関する具体的な管理策を整理しています。国内案件でも、これらの国際基準を参照してセキュリティ条項の網羅性を確認できます。

次のグラフは、各成熟度レベルにおける条項カテゴリ別のカバー率を示した概念モデルです。Level 1では多くのカテゴリで条項のカバー率が30%前後に留まりますが、Level 3ではすべてのカテゴリで90%以上のカバー率に到達します。

上記のカバー率は概念モデルであり、実際のカバー率は業種・案件内容・規制環境によって異なります。グラフから読み取れるポイントは、Level 1からLevel 2への移行でカバー率が大幅に改善する点です。特にセキュリティとデータ利用は、Level 1の状態が最もリスクが高い領域です。

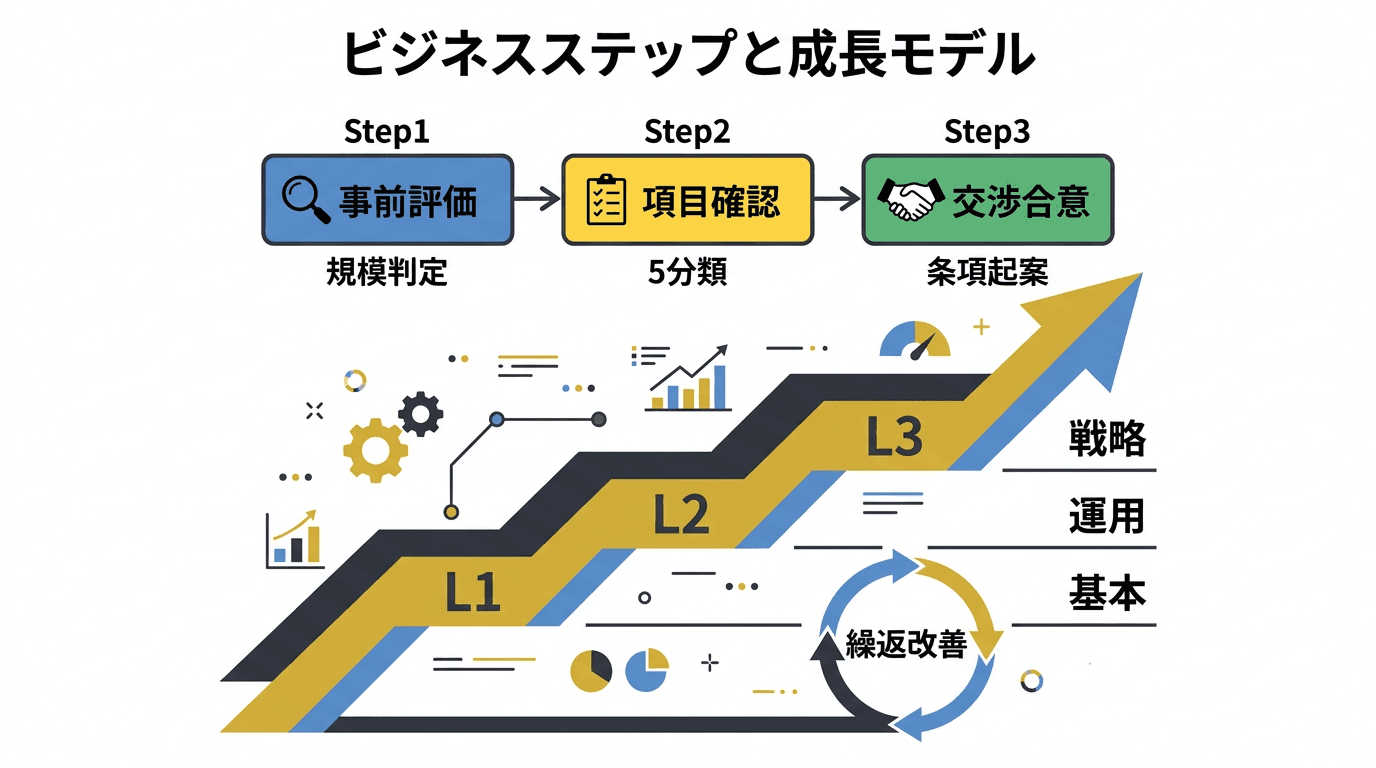

契約レビューフロー:3フェーズで漏れなく確認する

AI条項のレビューは「事前評価→カテゴリ別レビュー→評価・対応」の3フェーズで進めます。重要なのは、レビューに入る前に案件の特性を評価し、目指すべき成熟度レベルを先に決めてからカテゴリ別の確認に入る点です。

事前評価フェーズでは、案件の全体像を掴みます。案件規模(年間の委託金額と契約期間)、データ機微性(個人情報や営業秘密の有無と量)、規制影響(個人情報保護法やEU AI Actの適用有無)の3点を確認し、目指すべき成熟度レベルを決定します。この判断を曖昧にしたままレビューを始めると、「どこまでチェックすればよいか」の基準がぶれてしまいます。

カテゴリ別レビューフェーズでは、知的財産→データ利用→品質保証→責任分界→セキュリティの順にレビューします。この順序には理由があります。知的財産の条項(生成物の権利帰属)が決まらないとデータ利用の範囲が定まらず、品質保証は知的財産とデータ利用の前提に依存するためです。上流の条項から順に固めていくことで、下流の条項設計が効率的になります。

評価・対応フェーズでは、レビュー結果を成熟度レベルの基準と照合し、現在のレベルと目標レベルのギャップを特定します。ギャップが見つかった条項については修正案を起案し、受託者との交渉に進みます。このフローは一回きりではなく、契約更新のたびに繰り返すことで成熟度を段階的に引き上げていきます。

図4: 契約レビューの3フェーズ — 事前評価→カテゴリ別レビュー→交渉・合意を繰り返し、成熟度を段階的に引き上げる

条項交渉の実務:どこまで主張し、どこで折り合うか

契約条項の交渉では、「すべての条項を通したい」と構えると交渉が停滞します。条項ごとに優先度を整理し、交渉の落としどころを事前に設計しておくことが重要です。

交渉の優先順位を3段階で整理する

交渉に入る前に、各条項を「必須」「重要」「望ましい」の3段階に分類しておきます。

- 必須(譲れない条項): 法令遵守に直結する条項です。個人情報の取扱い、秘密保持、損害賠償の上限設定が該当します。ここは交渉の余地なく確保してください

- 重要(強く主張する条項): 実務上のリスク管理に直結する条項です。生成物の権利帰属、AI出力のレビュー義務、利用ツールの開示がここに含まれます。受託者が難色を示す場合は、代替案を用意しておきます。たとえば利用ツールの「事前承認制」が受け入れられなければ「事前報告制(拒否権付き)」に緩和するといった譲歩案です

- 望ましい(柔軟に対応する条項): あれば理想的だが、なくても運用でカバーできる条項です。監査権の行使頻度、品質レポートの提出サイクルなどが該当します。交渉が長引く場合は、別途覚書(サイドレター)で追加する方法も有効です

交渉を円滑にする2つの実務テクニック

国際標準を交渉の根拠にする。 EU Model Contractual Clauses for AI Procurement(EUのAI調達用標準契約条項、2025年6月公開)は、AI調達時の標準条項として全EU言語に翻訳・公開されています。「国際的に標準とされている条項です」と示すことで、受託者に「過剰な要求ではない」と理解してもらいやすくなります。

法改正への対応条項を入れる。 中長期の委託契約では、change-in-law条項(法令変更時の見直し条項)を入れておくことを強く推奨します。AI関連法制は変化が速く、締結時点の条項が短期間で陳腐化するリスクがあります。「関連法令・ガイドラインに重大な改正があった場合、改正の施行日から60日以内に契約条項の見直しを協議する」といった文言が実務的です。

契約条項だけでリスクは消えません。条項の実効性を担保するには、監査ログの取得、四半期ごとの定例レビュー、インシデント報告ルートの整備を、契約とセットで運用設計することが欠かせません。

ビフォー・アフター:A社の契約改善シナリオ

冒頭のA社が契約を見直した具体的なシナリオを見てみましょう。

ビフォー(Level 1未満): A社とB社の契約書には「成果物の著作権はA社に帰属する」「秘密情報は第三者に開示しない」という一般的な条項だけがありました。AI利用への言及はゼロです。B社がAIで生成した記事に他社コンテンツとの類似が見つかった際、A社は「AIを使うなとは書いていなかった」「権利侵害はB社の責任だ」と主張しましたが、B社は「AI利用を禁止する条項はない」「AIの出力に対する品質保証は合意していない」と反論しました。結局、3か月の交渉を経て、問題のコンテンツを差し替えるだけで終わり、根本的な契約改善には至りませんでした。

アフター(Level 2に引き上げ): A社は契約更新のタイミングで、以下の条項を追加しました。

- AI利用時の事前通知義務と利用ツールの開示

- 生成物の権利はA社に帰属し、B社は自社利用しない旨の明記

- AI出力の人的レビュー義務と、レビュー記録の保管

- 投入データのモデル学習への不使用条件

- 品質問題が発覚した場合の是正プロセスと費用負担

追加された条項は5項目、契約書の分量はA4用紙で2枚増えただけです。交渉に要した期間は2週間で、B社からの抵抗はほとんどありませんでした。B社としても「ルールが明確になったほうが仕事がやりやすい」というのが本音だったのです。

この改善により、A社は「何が起きたら誰がどう対応するか」を契約書で確認できる状態になりました。完璧ではありませんが、Level 1未満の状態と比較すればリスク管理の水準は格段に向上しています。次回の契約更新では、監査権とインシデント対応フローを追加してLevel 3を目指す計画です。

あわせて読みたい

- ガバナンス設計テンプレート:ログ・個人情報・著作権・社内利用ルールの作り方

- プライバシー同意管理の運用設計:6つの状態で曖昧さをなくす仕組み

- BPOベンダー比較の技術:提案書リテラシーで見極める12項目チェック

まとめ:AI契約条項強化の3原則

-

AI固有の条項を「別レイヤー」として設計します。 従来の業務委託契約にAI関連の一文を足すだけでは、生成物の権利、データの学習利用、品質変動といったAI固有のリスクに対応できません。5つの条項カテゴリ(知的財産・データ利用・品質保証・責任分界・セキュリティ)を体系的に整備してください

-

成熟度モデルで段階的に強化します。 すべての契約をいきなり最高レベルにする必要はありません。案件規模・データ機微性・規制影響の3条件で目指すべきレベルを判断し、Level 1→Level 2→Level 3と契約更新のたびにレベルを引き上げていくアプローチが実務的です

-

契約条項と運用設計をセットで考えます。 どんなに精緻な条項を盛り込んでも、運用が伴わなければ形骸化します。監査ログの取得、定例レビュー、インシデント報告ルートの整備を、契約条項と一体で設計することがリスク管理の実効性を担保します

あなたの会社では、業務委託先がAIを使っているかどうかを把握できていますか。もし契約書にAI関連の条項が1つもなければ、まずLevel 1の確保——「AI利用の事前通知義務」と「基本的なデータ保護条項」の追加から始めてみてください。

Agenticベースでは、AI条項を含む業務委託契約のレビュー支援から、成熟度モデルに基づく段階的な条項強化計画の策定、契約テンプレートの設計まで対応しています。 お問い合わせはこちら →

この記事の著者

Agentic Base 編集部

AIエージェントとWebメディア運用の知見を活かし、実践的なナレッジを発信しています。